کارت گرافیک H100 چیست؟

کارت گرافیک NVIDIA H100 پیشرفتهترین محصول نسل Hopper است که برای پردازشهای هوش مصنوعی، مدلهای زبانی بزرگ و محاسبات با مقیاس بسیار بالا طراحی شده است. این کارت با توان پردازشی فوقالعاده، حافظه سریع HBM3 و فناوری Transformer Engine به یکی از ارکان اصلی زیرساختهای AI در جهان تبدیل شده است. اگر میخواهید بدانید کارت گرافیک H100 چیست، چه کاربردهایی دارد و چرا تا این اندازه در صنعت خود، اهمیت پیدا کرده است، مطالعه ادامه این مقاله ار ایران GPU را از دست ندهید.

GPU H100 چیست؟

کارت گرافیک H100 یکی از انواع کارت گرافیک و نسل جدید پردازندههای گرافیکی دیتاسنتری شرکت انویدیا است که بر پایه معماری Hopper ساخته شده و نقطه عطفی در عملکرد سختافزارهای هوش مصنوعی به شمار میآید. این کارت با بیش از چهاردههزار هسته CUDA، حافظه فوق سریع HBM3 با ظرفیت ۸۰ گیگابایت و فناوری نوآورانه Transformer Engine، توان پردازشی بیسابقهای را برای آموزش مدلهای یادگیری عمیق، اجرای مدلهای زبانی بزرگ و محاسبات علمی پیچیده فراهم میکند.

H100 نهتنها سرعت آموزش و استنتاج مدلها را چندین برابر افزایش میدهد، بلکه با پشتیبانی از دقتهای FP8، FP16 و FP64 و قابلیت تقسیم GPU به چند بخش مستقل (MIG)، انعطافپذیری بالایی برای استفاده در دیتاسنترها و زیرساختهای ابری فراهم کرده است.

اگر بهدنبال اجرای سنگینترین مدلهای هوش مصنوعی، پردازش دادههای عظیم یا آموزش LLM هستید، کارت گرافیک H100 بهترین انتخاب حرفهایهاست. برای تجربه بیشترین سرعت، کمترین زمان آموزش و حداکثر بهرهوری، سرورهای GPU مجهز به H100 ایران GPU را امتحان کنید. همین حالا از صفحه خرید سرور GPU، سرور مناسب پروژهتان را انتخاب کنید.

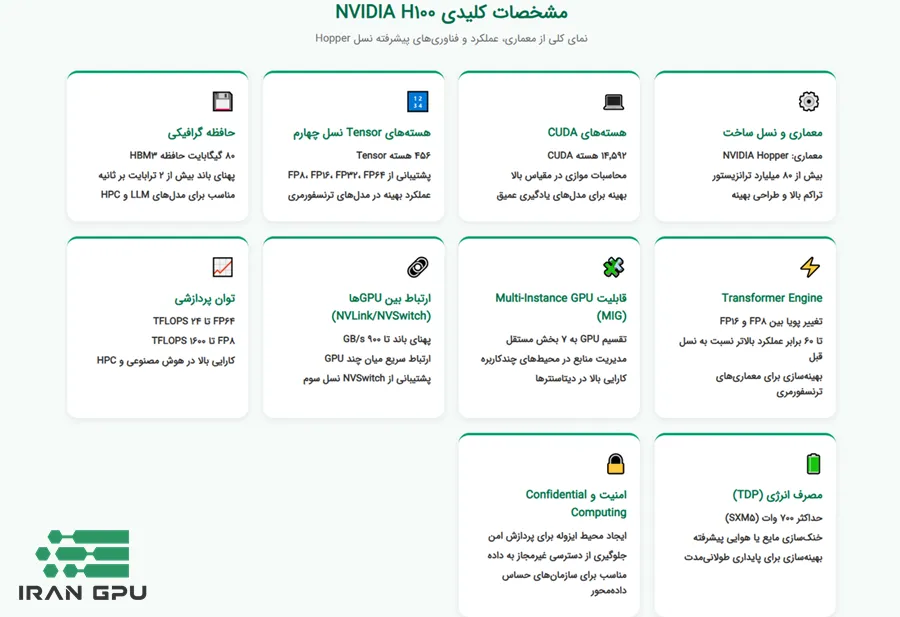

ویژگی های کارت گرافیک H100

برای اینکه بهتر درک کنیم که کارت گرافیک H100 چیست، باید ویژگیهای شاخص آن را بشناسیم. در ادامه مهمترین ویژگیهای این کارت گرافیک آمده است.

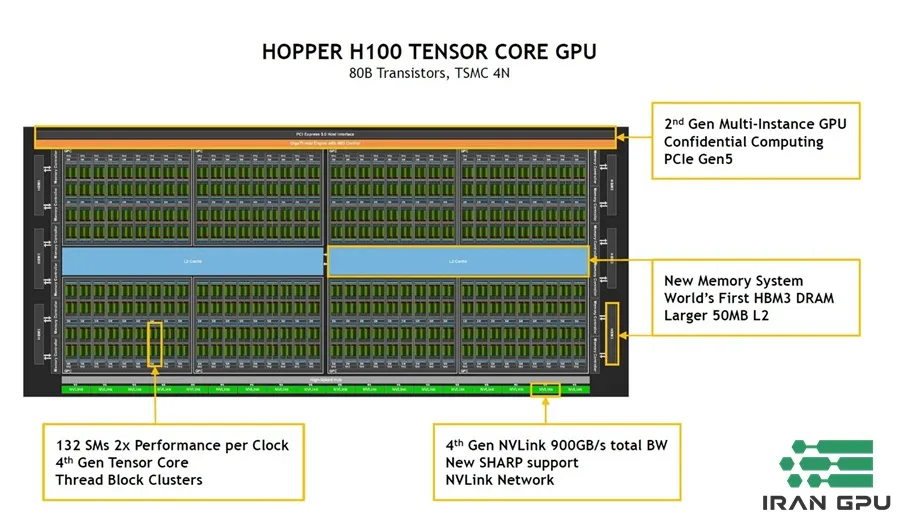

معماری Hopper

H100 با معماری Hopper عرضه شده است؛ ساختاری که بازطراحی کامل واحدهای پردازشی و حافظه را به همراه دارد. این معماری باعث شده مصرف انرژی کاهش و راندمان محاسباتی بهطور چشمگیری افزایش پیدا کند.

به نقل از NVIDIA

معماری Hopper انویدیا با موتور ترنسفورمر، هستههای تنسور نسل چهارم، دستورالعملهای DPX و NVLink پیشرفته، اجرای بارهای کاری بزرگ AI و HPC را با شتابی چندبرابری ممکن میکند؛ برای مدلهای ترانسفورمر میلیارد پارامتری، محاسبات دینامیک برنامهریزی و شبیهسازی علمی.

Tensor Core نسل چهارم

در H100 از نسل چهارم هستههای Tensor Core استفاده شده است. این هستهها سرعت اجرای عملیات ماتریسی و یادگیری عمیق را تا چندین برابر افزایش میدهند و برای مدلهای سنگینتر هوش مصنوعی بهینهسازی شدهاند.

هستههای تنسور نسل چهارم در معماری Hopper با موتور Transformer و استفاده از دقت مختلط FP8 بهطور قابل توجهی محاسبات هوش مصنوعی را شتاب میدهند و تا ۹ برابر سریعتر آموزش و تا ۳۰ برابر استنتاج را نسبت به نسل قبلی بهبود میبخشند.

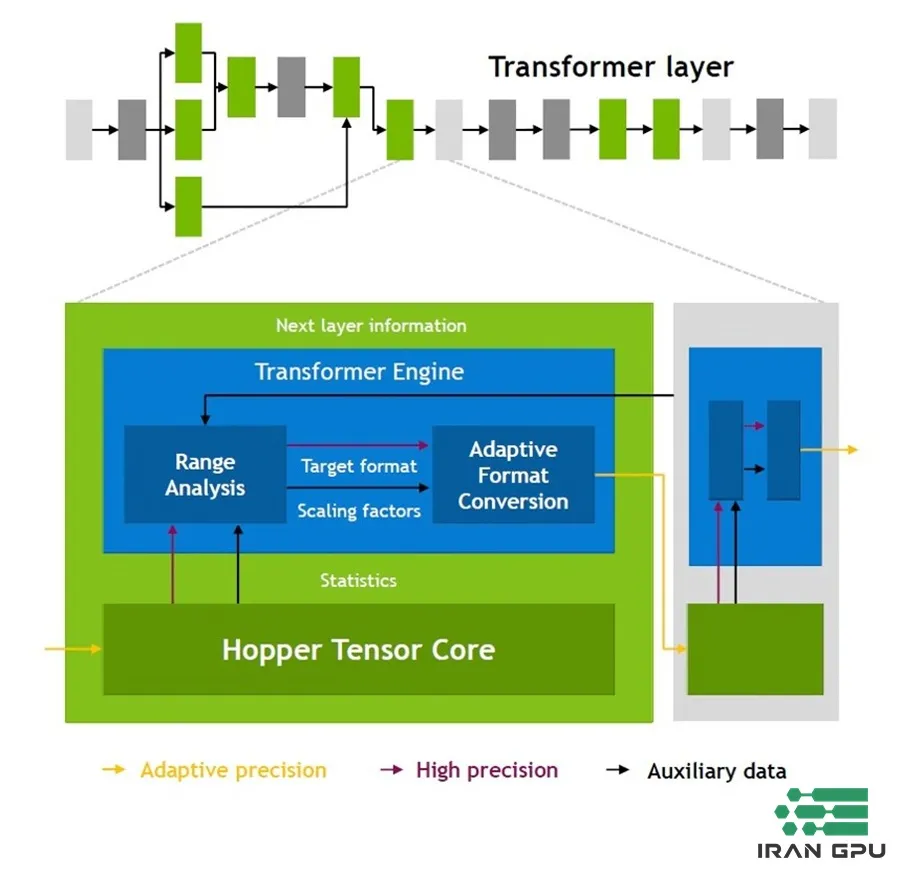

Transformer Engine

فناوری Transformer Engine مهمترین نوآوری این نسل است. این موتور هوشمند به GPU اجازه میدهد بسته به نوع محاسبه، بین دقت FP8 و FP16 جابهجا شود تا هم سرعت حفظ شود و هم دقت نتایج افت نکند؛ ویژگیای که آموزش مدلهای زبانی بزرگ را متحول کرده است.

فناوری Transformer Engine در GPU های Hopper انویدیا با استفاده از دقت مختلط FP8، مدلهای ترنسفورمر را سریعتر اجرا میکند و با مصرف کمتر حافظه، عملکرد آموزش و استنتاج را بهینه میکند.

Multi-Instance GPU (MIG)

قابلیت MIG نسل دوم در H100 این امکان را میدهد که کارت به چند بخش مستقل تقسیم شود. هر بخش با منابع اختصاصی خود فعالیت میکند و این موضوع برای اجرای همزمان چند پروژه در محیطهای ابری بسیار کاربردی است.

به نقل از NVIDIA

Multi-Instance GPU (MIG) فناوریای از انویدیا است که امکان تقسیم یک GPU فیزیکی به چندین نمونه مستقل را فراهم میکند. هر نمونه دارای هستههای محاسباتی، حافظه با پهنای باند بالا و کش مختص به خود است تا بتوان بارهای کاری مختلف را بهصورت همزمان با کیفیت سرویس تضمینی اجرا کرد.

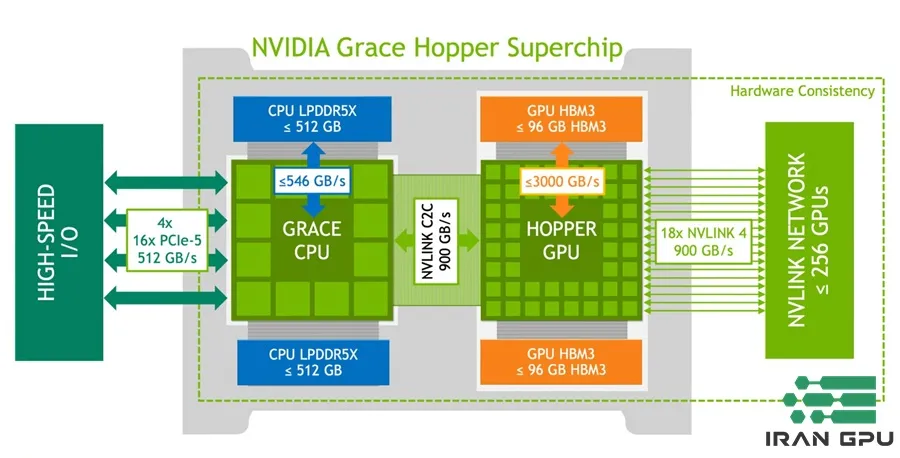

NVLink و NVSwitch

فناوری ارتباطی NVLink نسل چهارم و NVSwitch نسل سوم، تبادل داده میان چند GPU را تا سرعت ۹۰۰ گیگابایت بر ثانیه ممکن کردهاند. این سطح از ارتباط، بهرهوری را در ابررایانهها و سرورهای چند GPU افزایش میدهد.

به نقل از NVIDIA

NVLink یک اتصال بسیار سریع بین GPU و CPU است که بهواسطه پروتکلی قدرتمند، امکان تبادل داده را با سرعت باورنکردنی فراهم میکند.

امنیت و Confidential Computing

در H100 از فناوری Confidential Computing برای حفاظت از دادهها در هنگام پردازش استفاده شده است. این فناوری محیطی ایزوله ایجاد میکند تا دادههای حساس از هرگونه دسترسی ناخواسته در امان بمانند.

در جدول زیر، خلاصهای از ویژگیهای کارت گرافیک H100 آمده است.

| ویژگی | توضیح |

| معماری | Hopper |

| حافظه | ۸۰ گیگابایت HBM3 |

| پهنای باند حافظه | بیش از ۲ ترابایت بر ثانیه |

| هستهها | ۱۴٬۵۹۲ CUDA Core و ۴۵۶ Tensor Core |

| فناوری ویژه | Transformer Engine |

| قابلیت چندبخشی | MIG نسل دوم با ۷ بخش مستقل |

| ارتباط بین GPU ها | NVLink نسل چهارم و NVSwitch نسل سوم |

| دقتهای پشتیبانیشده | FP64، FP32، FP16، BF16، FP8 |

| توان حرارتی | حدود ۷۰۰ وات (نسخه SXM5) |

| کاربرد اصلی | آموزش مدلهای هوش مصنوعی، HPC و مدلهای زبانی بزرگ |

مشخصات کارت گرافیک H100 چیست؟

کارت گرافیک H100 نهتنها از نظر معماری و فناوری، بلکه از نظر مشخصات فنی نیز جهشی بزرگ نسبت به نسل قبل (A100) دارد. در ادامه، جزئیات فنی این کارت بهصورت کامل آورده شده است. (پیشنهاد میکنیم برای آشنایی بیشتر با GPU A100، مقاله کارت گرافیک A100 چیست را مطالعه کنید.)

- معماری و ساخت تراشه

H100 بر پایه معماری NVIDIA Hopper طراحی شده و از تراشهای با بیش از ۸۰ میلیارد ترانزیستور بهره میبرد. این طراحی موجب افزایش چشمگیر سرعت و بازده در اجرای مدلهای پیچیده شده است.

- هستهها و توان محاسباتی

این کارت دارای ۱۴٬۵۹۲ هسته CUDA و ۴۵۶ هسته Tensor Core است. توان محاسباتی آن در حالت FP64 حدود ۲۴ ترافلاپس و در حالت FP8 با Transformer Engine تا ۱۶۰۰ ترافلاپس میرسد.

- حافظه و پهنای باند

حافظه بهکاررفته در H100 از نوع HBM3 با ظرفیت ۸۰ گیگابایت است. این حافظه پهنای باندی بیش از ۲ ترابایت بر ثانیه فراهم میکند و اجرای مدلهای حجیم را بدون گلوگاه حافظه ممکن میسازد.

- دقتهای محاسباتی

H100 از طیف وسیعی از دقتهای عددی از جمله FP64، FP32، FP16، BF16 و FP8 پشتیبانی میکند تا کاربران بتوانند بسته به نیاز، بین سرعت و دقت تعادل برقرار کنند.

- توان و خنکسازی

توان حرارتی نسخه SXM5 این کارت تا حدود ۷۰۰ وات است و برای عملکرد پایدار، به سیستم خنکسازی پیشرفته (مایع یا هوایی) نیاز دارد.

- قابلیتهای توسعه و اتصال

این کارت از رابط PCIe Gen 5 استفاده میکند و با فناوریهای NVLink نسل چهارم و NVSwitch نسل سوم، مقیاسپذیری چند GPU را در سطح سرورهای ابری ممکن میسازد.

به نقل از NVIDIA

NVSwitch یک سوئیچ داخلی با قابلیت NVLink است که ارتباط میان GPU ها را با سرعت بسیار بالا امکانپذیر میکند؛ بهطوریکه ۱۶ GPU در یک سرور مانند یک واحد محاسباتی یکپارچه رفتار کنند.

جدول مشخصات کارت گرافیک H100 به صورت زیر است:

| مشخصه | توضیح |

| معماری | NVIDIA Hopper |

| تعداد ترانزیستورها | بیش از ۸۰ میلیارد |

| هستهها | ۱۴٬۵۹۲ CUDA و ۴۵۶ Tensor Core |

| حافظه | ۸۰ گیگابایت HBM3 |

| پهنای باند حافظه | حدود ۲ ترابایت بر ثانیه |

| دقتهای پشتیبانیشده | FP64، FP32، FP16، BF16، FP8 |

| رابط اتصال | PCIe Gen5 / SXM5 |

| NVLink | نسل چهارم (تا ۹۰۰ GB/s) |

| توان مصرفی | حداکثر ۷۰۰ وات |

| قابلیت MIG | تقسیم به ۷ بخش مجزا |

| فناوری ویژه | Transformer Engine برای مدلهای زبانی بزرگ |

کاربردهای کارت گرافیک NVIDIA H100

در توضیحات فوق با اینکه کارت گرافیک H100 چیست و مشخصات و ویژگیهای آن آشنا شدیم. در این بخش، کاربردهای آن را بررسی خواهیم کرد. کارت گرافیک NVIDIA H100 برای اجرای سنگینترین پروژههای محاسباتی و یادگیری عمیق طراحی شده است. در ادامه، چهار کاربرد اصلی آن معرفی شده است.

آموزش مدل های هوش مصنوعی در مقیاس بزرگ

H100 با پشتیبانی از حافظه HBM3 و Transformer Engine سرعت آموزش مدلهای یادگیری عمیق را به شکل چشمگیری افزایش میدهد. این کارت بهطور ویژه برای پروژههایی با دادههای گسترده و شبکه های عصبی هوش مصنوعی بسیار بزرگ طراحی شده است.

- آموزش مدلهای زبانی بزرگ (LLM) با صدها میلیارد پارامتر

- آموزش شبکههای بینایی کامپیوتر با حجم تصویر بالا

- بهکارگیری در سیستمهای آموزشی چند GPU برای مقیاسپذیری بیشتر

استنتاج (Inference) و پردازش بلادرنگ

توان محاسباتی در حالت FP8 و FP16 باعث میشود H100 استنتاج مدلها را با سرعت بسیار بالا و تأخیر کم انجام دهد. این ویژگی آن را برای پیادهسازی هوش مصنوعی در محیطهای عملیاتی ایدهآل کرده است.

- پاسخدهی سریع مدلهای مکالمه و ترجمه زبانی

- اجرای مدلهای تشخیص تصویر و ویدیو در زمان واقعی

- استقرار سرویسهای ابری مبتنیبر هوش مصنوعی با بار بالا

محاسبات علمی و شبیه سازی های پیچیده (HPC)

H100 توانایی اجرای حجم عظیمی از عملیات عددی را دارد و در پروژههای علمی، صنعتی و تحقیقاتی بهکار گرفته میشود. ترکیب FP64 و پهنای باند بالا باعث شده اجرای محاسبات فیزیکی و مهندسی با دقتی بیسابقه انجام شود.

- مدلسازی پدیدههای فیزیکی و جریانهای سیال

- شبیهسازی مولکولی و طراحی دارو در مقیاس اتمی

- تحلیل دادههای ژنومی و زیستمحاسباتی پیشرفته

به نقل از IBM

محاسبات با کارایی بالا (HPC) فناوریای است که از خوشهای از پردازندههای قدرتمند استفاده میکند تا مجموعهدادههای عظیم چندبعدی را بهصورت موازی پردازش کند و مسائل پیچیده را با سرعت بسیار بالا حل نماید.

استفاده در زیرساخت های ابری و دیتاسنتری

H100 برای کار در محیطهای ابری بهینهسازی شده و امکان تقسیم GPU به چند بخش مستقل را فراهم میکند. این قابلیت بهرهوری و مقیاسپذیری را برای شرکتها و مراکز داده افزایش میدهد.

- پردازش چندکاربره با استفاده از قابلیت MIG نسل دوم

- استقرار مدلهای هوش مصنوعی در پلتفرمهای ابری سازمانی

- استفاده در سرورهای چند GPU با ارتباط NVLink نسل چهارم

مقایسه کارت گرافیک A100 و H100

کارتهای گرافیک NVIDIA A100 و H100 هر دو برای پردازشهای سنگین هوش مصنوعی و HPC طراحی شدهاند، اما H100 یک نسل جلوتر و بهمراتب قدرتمندتر است. معماری Hopper در H100 نسبت به معماری Ampere در A100 عملکرد بسیار بهتری در آموزش و استنتاج مدلهای بزرگ ارائه میدهد و به لطف نسل چهارم Tensor Core و Transformer Engine سرعت پردازش مدلهای زبانی بزرگ (LLM) را چند برابر افزایش میدهد.

علاوهبراین، H100 پهنای باند حافظه بالاتر، مصرف انرژی بهینهتر و پشتیبانی عمیقتری از قابلیتهای چندگانهسازی GPU مثل MIG دارد. در مجموع، A100 همچنان گزینهای قدرتمند و مقرونبهصرفه برای بسیاری از تیمهاست، اما اگر به بیشترین بازده در پروژههای LLM، مدلهای چندمیلیاردپارامتری و آموزشهای توزیعشده نیاز دارید، H100 انتخاب قطعی و آیندهمحور است.

راهنمای خرید سرور GPU

برای خرید انواع سرور GPU مانند H100 ابتدا باید مشخص کنید که قصدتان آموزش مدلهای سنگین هوش مصنوعی است یا اجرای پردازشهای سبکتر. اگر پروژهها شامل مدلهای بزرگ یا شبکههای عصبی پیچیده هستند، کارتهایی مثل H100، A100 یا RTX 4090 انتخابهای ایدهآلاند؛ اما برای کارهای سبکتر میتوان از کارتهای اقتصادیتر استفاده کرد.

در انتخاب سرور به مواردی مثل میزان VRAM کارت گرافیک، نوع معماری GPU، تعداد کارتها، CPU قوی و سازگاری آن با GPU، خنککاری مناسب، پهنای باند شبکه و نوع ذخیرهسازی (NVMe) توجه کنید. همچنین اگر از سرویسدهندگان داخلی خرید یا اجاره میکنید، حتماً وضعیت پایداری زیرساخت، سطح پشتیبانی، SLA، امنیت دادهها و قیمتگذاری را بررسی کنید. در نهایت بهترین سرور GPU، سرویسی است که متناسب با بودجه، نوع پروژه و مقیاس پردازش شما بالاترین بازده را ارائه دهد.

راهکار ایران GPU

اگر بهدنبال تجربه واقعی قدرت H100 بدون نیاز به خرید سختافزار گرانقیمت هستید، زیرساخت ایران GPU گزینهای ایدهآل برای شماست. با استفاده از سرورهای مجهز به GPU نسل جدید، میتوانید پروژههای یادگیری عمیق، مدلسازی و پردازش سنگین را در محیطی پایدار، مقیاسپذیر و مقرونبهصرفه اجرا کنید. همین حالا پلن مناسب خود را انتخاب و قدرت نسل Hopper را در عمل تجربه کنید.

جمعبندی: GPU H100 چیست؟

در مطلب فوق در رابطه با اینکه کارت گرافیک H100 چیست اطلاعاتی کامل ارائه شد. این کارت گرافیک در واقع نقطه اوج فناوری در حوزه پردازشهای هوش مصنوعی و محاسبات فوقسنگین است. این کارت با ترکیب قدرت، دقت و نوآوری، زیرساختی ایدهآل برای آموزش و استنتاج مدلهای هوش مصنوعی در مقیاس سازمانی فراهم میکند. انتخاب H100 یعنی ورود به نسل جدیدی از سرعت، کارایی و بهرهوری در پردازش داده.

سوالات متداول

- تفاوت H100 با A100 در چیست؟

H100 از معماری Hopper استفاده میکند و ازنظر سرعت، حافظه و توان پردازشی تا چند برابر از A100 قویتر است.

- آیا H100 برای استفاده شخصی مناسب است؟

خیر؛ این کارت برای دیتاسنترها و محیطهای ابری طراحی شده و هزینه بسیار بالایی دارد.

- H100 بیشتر برای چه پروژههایی کاربرد دارد؟

برای آموزش مدلهای زبانی بزرگ، شبیهسازیهای علمی و سرویسهای ابری هوش مصنوعی.

- آیا H100 از چندکاربره بودن پشتیبانی میکند؟

بله؛ فناوری MIG نسل دوم امکان تقسیم GPU به چند بخش مستقل را فراهم میکند.